誰もがAIと共に暮らす時代へ

気づけば、AIは私たちの暮らしに深く入り込んでいます。

SNSの投稿、動画のおすすめ、ネット広告の表示。

その裏側では、AIが常に判断や選別を行っています。

仕事でも同じです。

議事録の作成、文章の下書き、アイデア出しなど。

AIを活用する場面は、日々広がりを見せています。

その便利さを実感する人も多いでしょう。

しかし同時に、迷いもあるのではないでしょうか。

「どこまで信じていいのか?」

「どう使えば、うまく活かせるのか?」

AIを正しく理解せずに使い続けることには、リスクが伴います。

誤った情報を信じたり、個人情報が漏洩したり。

詐欺に巻き込まれることもあるかもしれません。

この記事では、AI時代に私たちが直面する課題とリスクを整理します。

そのうえで、誰もが身につけておきたい「AIを知る力」── AIリテラシーの育て方を、一緒に考えていきましょう。

AIについて知るとは、具体的には何を知ることか?

「AIについて知る」と聞くと、専門的な知識やプログラミングを想像するかもしれません。

確かに、ある程度の技術的理解は無視できません。

でも、日々の暮らしで本当に必要なのは、AIとどう付き合い、どう判断するかという力です。

このような力を「AIリテラシー」と呼びます。

操作方法だけでなく、見極め、活かし、制御するための知恵。

それは今や、スマホの使い方を覚えるのと同じくらい、当たり前に求められる”現代の基礎教養”となっています。

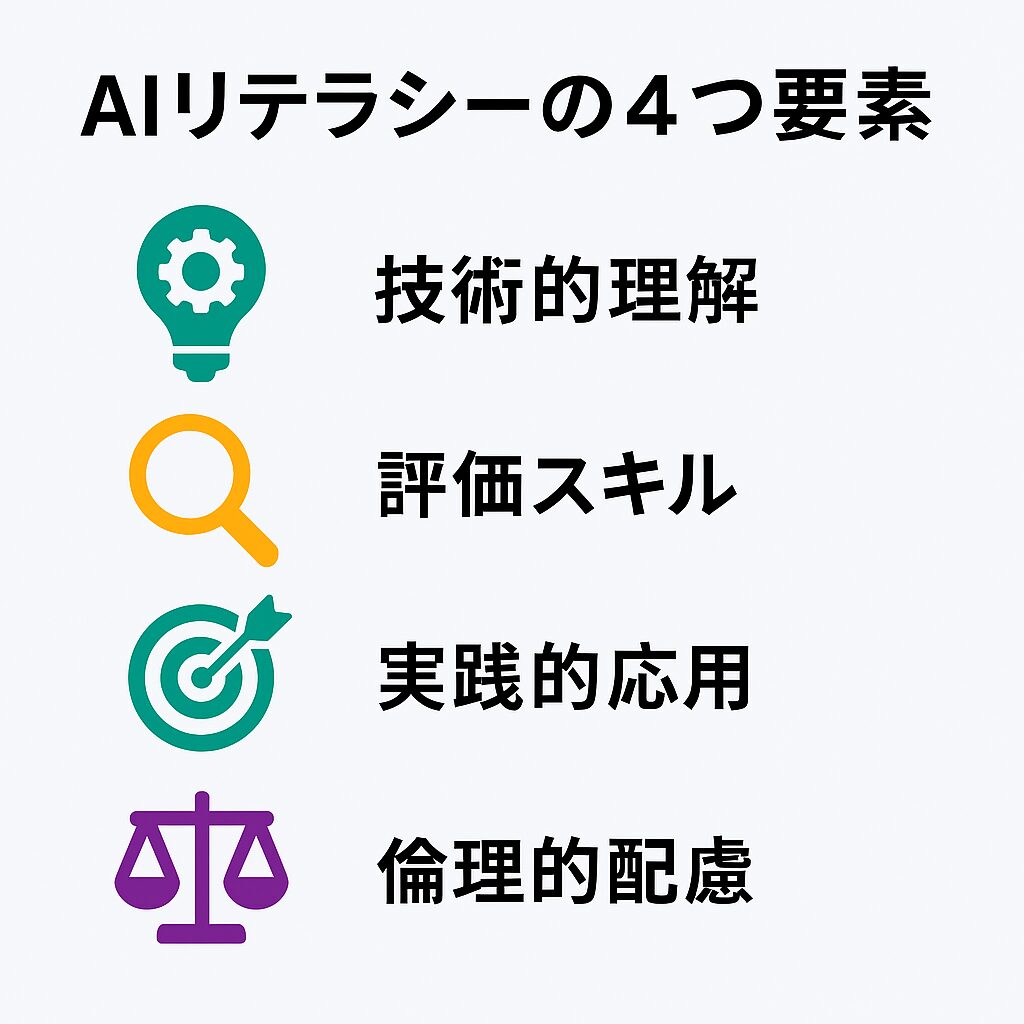

教育評価の専門家Kevin R. Guidry氏は、このAIリテラシーを次の4つの柱に整理しています。

1. 技術的理解

AIがどう動き、どう学び、どのように答えを出すのか。

その基本的な仕組みを知ることで、過信も誤信も避けられます。

2. 評価スキル

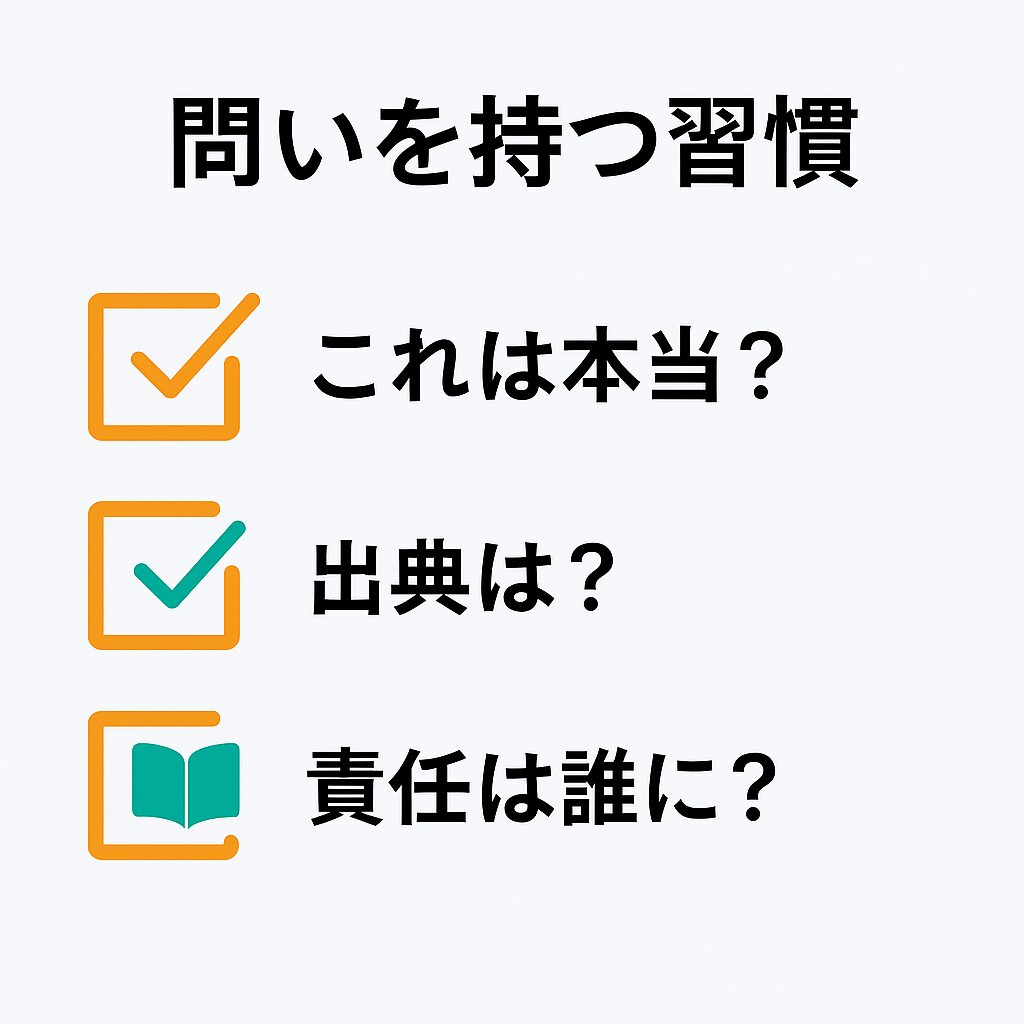

流暢な出力に惑わされず、「本当に正しいか?」「根拠があるか?」を見抜く目。

AIの発する言葉の真偽を、鵜呑みにせずに見極める力のことです。

3. 実践的応用

AIの得意・不得意を見極め、状況に応じて使い方を変える力。

これが身につけば、AIは“使える道具”に変わります。日常も仕事も、質が変わります。

4. 倫理的配慮

その使い方により、誰かの権利や尊厳が傷つけられていないか。

AIを使う人間にこそ、社会に対する責任があります。

AI時代におけるリスク──身近な事例から

AIの普及により便利さが増す一方で、新たなリスクも浮上しています。

以下に、実際に起きた事例をもとに、AIにまつわるリスクを紹介します。

誤情報を信じるリスク──AIのハルシネーション

生成AIは、あたかも事実であるかのように、存在しない情報をつくり出すことがあります。

ある自治体の観光サイトでは、AIが生み出した“幻の名所”や“架空の店舗”が掲載されていました。

原因は、検証を怠った人間の側にありました。

詐欺・悪用のリスク──ディープフェイク

技術が進化すれば、悪意もまた洗練されます。

「性的ディープフェイク」と呼ばれる合成画像が、世界中で被害を広げています。

日本では法整備が追いつかず、被害者が声を上げても救済されにくいという深刻な現実があります。

情報漏洩のリスク──AIとセキュリティの隙間

2023年、サムスン電子で起きた出来事。

従業員がChatGPTに社内の機密情報を入力したことで、社外への漏洩が発覚しました。

結果、同社は社内でのAI利用を全面禁止。

便利さの裏に潜むセキュリティの盲点が、企業の中枢を直撃した形です。

著作権・法令のリスク──無断学習と生成

新聞記事やイラストが、無断でAIの学習材料にされている。

そんな実態に、メディアやクリエイターが声を上げ始めました。

2024年、日本新聞協会は「報道へのフリーライドを許さない」と異例の声明を発表しています。

これらは氷山の一角にすぎません。

問題はAIそのものではありません。

AIを知るとは、こうしたリスクを知り、それに備える力を持つことも含まれるのです。

AIリテラシーをどう育てるか?──判断力と責任感の土台づくり

1. 実際に使ってみる

AIは、使ってこそ理解できます。

出力を読み、検証し、間違いに気づく練習を繰り返す中で、ハルシネーションの傾向や限界が肌感覚でつかめるようになります。

漫然と使うのではなく、「なぜこう答えたか?」を問いながら使うこと。

それが学びになるのです。

2. 出典を確認する習慣を持つ

もっともらしい言い回しに騙されないためには、「根拠は?」「情報源は?」と問い返す習慣が不可欠です。

Perplexityなど出典表示型のAIを使ったり、一次資料に立ち返る姿勢を持つことで、誤信を防ぐ助けになります。

これは、AIだけでなく人間が語る情報にも通じる、普遍的なスキルでもあるでしょう。

3. 身近な場で話し合う

AIを一人で抱え込まないこと。

職場ならばルールや方針を共有し合う場を持つ必要があります。

情報漏洩やコンプライアンス違反は、個人だけでなく組織を巻き込むリスクとなるからです。

家庭では、子どものアプリ利用やネット上のAIサービスについて、「どこまで使っていいのか」を一緒に話し合うことが、第一の防波堤になるでしょう。

4. 信頼できる学習機会を活用する

専門書ばかりに頼る必要はありません。

公的機関が提供するガイドラインや、教育的な動画・チャンネル、入門書の活用も有効です。

- AI総合研究所『生成AIガイドライン一覧』

- NHK for School(子ども向けの視点で本質を捉える)

- 教育系YouTubeチャンネル(SHIFT AIニュース、#usutaku_channel など)

- 入門書(『図解まるわかり AIのしくみ』『猫でもわかる生成AI』『AIに負けない子どもを育てる』など)

信頼できる情報を、信頼できる手段で得る。

それが、AI社会における最低限の防御線です。

AIリテラシーとは操作のうまさではありません。

問い、確かめ、語り合い、学び続ける姿勢そのものです。

最後に──AIを知るとは、自分と社会を守る力にすること

AIリテラシーは、単なる便利な知識ではありません。

それは、誤った情報に流されず、自分と社会を守るための盾であり、

同時に、技術と共に歩むための地図でもあります。

AIと共に生きる時代に、問われるのは技術力の高さではありません。

むしろ、「この情報は本当に正しいのか?」「私はその発信に責任を持てるのか?」

そう自らに問いかける姿勢こそが重要な力です。

AIとどう共に生きていくか──その答えは、AIについて“知ること”から始まります。

参考文献・出典一覧

- Wikipedia contributors「AI literacy」Wikipedia(2025年6月6日閲覧)

- Kevin R. Guidry「AI Literacy Literature Summary」California State University(2025年6月6日閲覧)

- 文部科学省「生成AIの利用に関する文部科学省のガイドライン」文部科学省(2025年6月6日閲覧)

- SHIFT AI「文部科学省の生成AIガイドラインをわかりやすく解説!学校教育での活用指針・注意点は?」SHIFT AI(2025年6月6日閲覧)

- 厚生労働省「AIリテラシー」厚生労働省(2025年6月6日閲覧)

- yuchan.com編集部「AIリテラシーを親子で身につける方法」yuchan.com(2025年6月6日閲覧)

- 東京新聞「福岡県に「鹿児島湾」?生成AIでデタラメ記事だらけの観光情報サイト 福岡市が後援取り消し」東京新聞、2024年11月23日(2025年6月6日閲覧)

- 朝日新聞「広がるデジタル性被害 リスクを減らすため、親ができること」朝日新聞、2024年12月21日(2025年6月6日閲覧)

- 毎日新聞「性的ディープフェイク 被害者泣き寝入りも 直接規制なき日本」毎日新聞、2025年5月29日(2025年6月6日閲覧)

- NHK「“性的ディープフェイク 子ども実在で法規制対象”法務省見解」NHK、2025年4月9日(2025年6月6日閲覧)

- Forbes JAPAN編集部「サムスン、ChatGPTの社内使用禁止 機密コードの流出受け」Forbes JAPAN、2023年5月3日(2025年6月6日閲覧)

- 東大新聞オンライン「生成AI著作権侵害の責任はどこに?賢いAIとの向き合い方を東大教授と考える」東大新聞オンライン、2025年1月15日(2025年6月6日閲覧)

- 日本新聞協会「生成AIにおける報道コンテンツの無断利用等に関する声明」日本新聞協会、2024年7月17日(2025年6月6日閲覧)